L’intelligence artificielle au bout des doigts – Connaissez-vous les risques de l’IA au sein de la défense?

Le 26 mai 2025 - Nouvelles de la Défense

L'intelligence artificielle est un outil puissant qui peut améliorer la productivité dans diverses tâches, cependant, il est essentiel d'établir des limites pour garantir une utilisation sécuritaire. Avant de saisir des informations dans un outil d'IA générative, considérez les risques. Même des détails apparemment insignifiants peuvent être stockés et accessibles en ligne.

Dans le contexte du MDN et des FAC, les enjeux sont encore plus importants - des individus malveillants pourraient combiner diverses informations de manière à menacer la sécurité nationale.

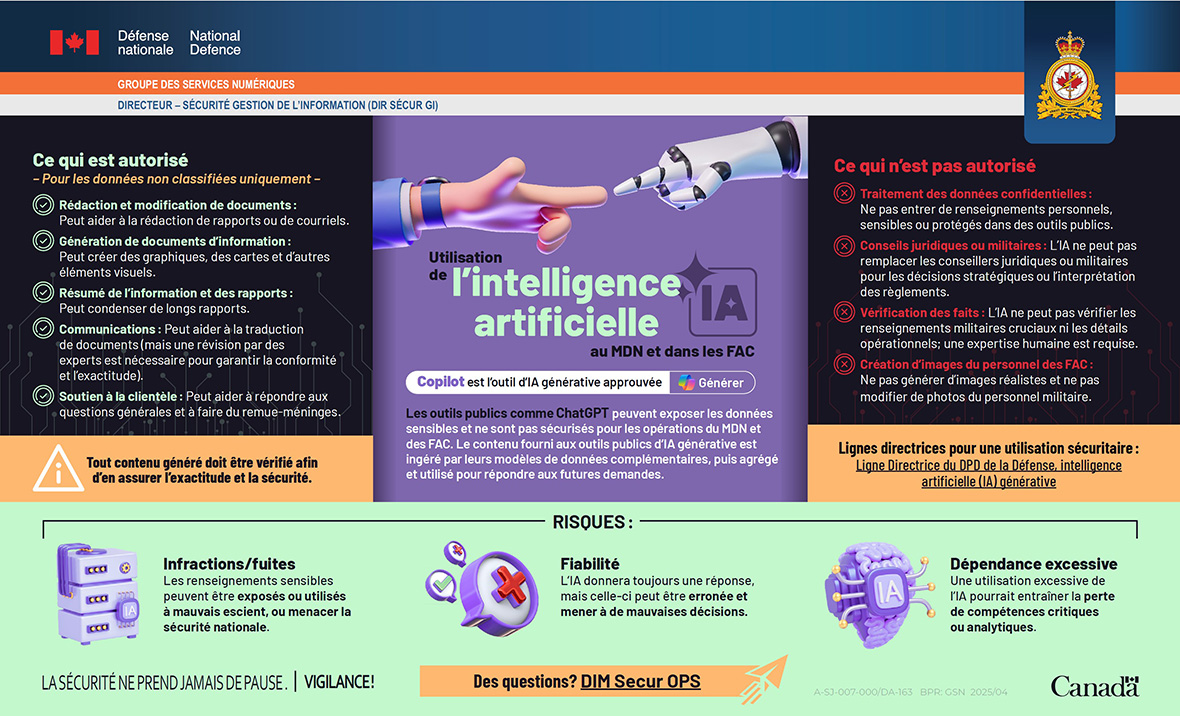

L'infographie ci-dessous présente les lignes directrices sur ce qui est permis et ce qui ne l'est pas, tandis que la vidéo animée illustre les risques associés à l'utilisation de l'IA au sein du MDN et des FAC.

Pour de plus amples renseignements sur différents sujets liés à la sécurité, veuillez consulter la Boîte à outils pour la sensibilisation à la sécurité, disponible sur la page intranet du Directeur général de la sécurité de la Défense (DGSD).

Questions?

Vidéo / Le 26 mai 2025

Transcription

Utilisation de l’intelligence artificielle générative au MDN et dans les FAC

Une simple modification peut entraîner une grave erreur.

Capitaine Smith devait peaufiner une note de service sensible sur les déploiements de troupes. Serrée dans le temps, elle a copié une ébauche dans un outil d'IA public pour obtenir des suggestions grammaticales.

L'IA l'a modifiée à la perfection, mais son contenu était désormais enregistré.

Des semaines plus tard, un journaliste a publié un article en ligne contenant des détails étrangement similaires, suggérant qu’une fuite d'informations sensibles avait eu lieu.

La capitaine Smith n'avait pas volontairement rendu ces informations publiques, mais l'IA les a rendues accessibles.

Les outils d'IA publics peuvent sembler inoffensifs, mais ils ne sont pas sécurisés pour le MDN et les FAC.

Certains raccourcis ne valent pas le risque.

Copilot est l'IA approuvée, mais doit être utilisé de manière responsable (uniquement avec des données non classifiées).

Infographie – Version texte

Utilisation de l’intelligence artificielle générative au MDN et dans les FAC

Outils autorisés :

- Copilot est l’outil d’IA générative approuvée

- Les outils publics comme ChatGPT peuvent exposer les données sensibles et ne sont pas sécurisés pour les opérations du MDN et des FAC. Le contenu fourni aux outils publics d’IA générative est ingéré par leurs modèles de données complémentaires, puis agrégé et utilisé pour répondre aux futures demandes.

Ce qui est autorisé :

Pour les données non classifiées uniquement :

- Rédaction et modification de documents : Peut aider à la rédaction de rapports ou de courriels.

- Génération de documents d’information : Peut créer des graphiques, des cartes et d’autres éléments visuels.

- Résumé de l’information et des rapports : Peut condenser de longs rapports.

- Communications : Peut aider à la traduction de documents (mais une révision par des experts est nécessaire pour garantir la conformité et l’exactitude).

- Soutien à la clientèle : Peut aider à répondre aux questions générales et à faire du remue-méninges.

Ce qui n’est pas autorisé :

- Traitement des données confidentielles du MDN et des FAC : Ne pas entrer de renseignements personnels, sensibles ou protégés dans des outils publics.

- Conseils juridiques ou militaires : L’IA ne peut pas remplacer les conseillers juridiques ou militaires pour les décisions stratégiques ou l’interprétation des règlements.

- Vérification des faits : L’IA ne peut pas vérifier les renseignements militaires cruciaux ni les détails opérationnels; une expertise humaine est requise.

- Création d’images du personnel des FAC : Ne pas générer d’images réalistes et ne pas modifier de photos du personnel militaire.

Risques :

- Infractions/fuites : Les renseignements sensibles peuvent être exposés ou utilisés à mauvais escient, ou menacer la sécurité nationale.

- Fiabilité : L’IA donnera toujours une réponse, mais celle ci peut être erronée et mener à de mauvaises décisions.

- Dépendance excessive : Une utilisation excessive de l’IA pourrait entraîner la perte de compétences critiques ou analytiques.

Lignes directrices pour une utilisation sécuritaire :

Des questions? dirimsecurops@forces.gc.ca