Stratégie en matière d’intelligence artificielle: Immigration, Réfugiés et Citoyenneté Canada

Sur cette page

- Message du sous-ministre

- Message du dirigeant principal du numérique

- Résumé

- Contexte

- Officialiser la stratégie en matière d’IA du Ministère

- La voie à suivre : Miser sur l’intelligence artificielle

- Cadre pour l’adoption de l’IA

- Prochaine étape : mise en œuvre

- Conclusion

- Glossaire

- Notes de bas de page

Message du sous-ministre

L’intelligence artificielle (IA) fait désormais partie intégrante de notre quotidien . Elle améliore notre productivité et nous offre une commodité que nous tenons parfois pour acquise. La capacité de l’IA à analyser de grandes quantités de données à des vitesses sans précédent permet de réaliser des avancées dans différents domaines, allant de la climatologie et des soins de santé à la finance, aux transports, à l’éducation et à la fabrication.

Malgré l’immense pouvoir de l’IA, l’application d’une approche humaniste est essentielle à l’exploitation responsable de son potentiel. C’est particulièrement vrai dans des domaines comme l’immigration, qui ont une incidence profondément personnelle et souvent concrète sur la vie des gens. Si l’IA excelle dans le traitement des données, elle manque de compréhension nuancée et de jugement éthique. Pour que l’IA profite réellement à la société et ne nuise pas aux populations vulnérables, il faut régir son utilisation en s’appuyant sur des valeurs humaines comme la transparence, l’antiracisme et la responsabilisation.

Pour faire face à cette situation, Immigration, Réfugiés et Citoyenneté Canada (IRCC) a officialisé sa gouvernance de l’IA dans sa stratégie en matière d’IA inaugurale, en veillant à ce que son approche soit en harmonie avec la Stratégie en matière d’IA pour la fonction publique fédérale 2025-2027. Cette harmonisation garantit que l’utilisation de l’IA par IRCC appuie l’engagement du gouvernement du Canada à adopter l’IA de façon responsable, transparente et sûre dans toutes les institutions fédérales. Notre Stratégie renforce également l’importance qu’accorde le gouvernement du Canada à une capacité d’IA centrale, aux politiques et à la gouvernance, à la préparation de l’effectif et à la mobilisation du public – tous des éléments essentiels pour maintenir la confiance du public envers les services gouvernementaux fondés sur l’IA.

Notre Stratégie établit les balises pour l’adaptation aux besoins ministériels, la gestion des menaces à la cybersécurité et la protection de l’intégrité des programmes. Fondée sur les pratiques exemplaires internationales et les orientations du gouvernement du Canada, la Stratégie s’appuie sur les employés et les intervenants afin de rester sur la bonne voie, grâce à la collaboration et à l’amélioration continues. La Stratégie d’IRCC en matière d’IA est le fruit d’un travail d’équipe, et d’années d’expérimentation et de collaboration dans l’ensemble du Ministère. Alors que nous cheminons sur la voie à suivre, cette vision guidera notre travail et soutiendra l’utilisation éthique et inclusive de l’IA au Ministère.

Dr Harpreet S. Kochhar

Sous-ministre de l’Immigration,

des Réfugiés et de la Citoyenneté du Canada

Message du dirigeant principal du numérique

J’ai le plaisir de vous présenter la Stratégie d’IRCC en matière d’IA.

IRCC joue un rôle crucial dans le façonnement du paysage socioéconomique du Canada en facilitant l’immigration, en prônant la diversité et en soutenant l’intégration des nouveaux arrivants.

Étant donné qu’IRCC recueille une grande quantité de renseignements personnels pour fournir ses programmes et services, notre stratégie en matière d’IA affirme notre engagement permanent à protéger et à sécuriser la vie privée de nos clients.

En tant qu’organisation, nous explorons continuellement les technologies émergentes pour nous aider à automatiser les étapes de nos opérations afin d’améliorer l’efficacité et l’intégrité des programmes. Depuis 2018, le Ministère utilise l’analytique avancée et l’apprentissage automatique pour nous aider à acquérir des connaissances approfondies grâce aux données sur les programmes et les demandeurs. Aujourd’hui, alors que nous étudions attentivement les possibilités offertes par les nouvelles technologies d’IA, notre stratégie en matière d’IA s’appuie sur la gouvernance existante pour tracer la voie d’une expérimentation rigoureuse et d’une adoption sûre de l’IA à des fins plus diverses.

Nous sommes conscients des avantages considérables qu’apporte l’IA et de la nécessité urgente de l’adopter dans le monde d’aujourd’hui. Nous explorons ou continuons d’explorer la mise à profit de l’IA pour améliorer le service à la clientèle, réaliser des gains d’efficacité dans nos opérations, améliorer l’intégrité des programmes et protéger le système d’immigration contre la fraude et les cyberincidents. Nous sommes déterminés à être à l’avant-garde de l’adoption responsable des technologies. Pour nous assurer d’être sur la bonne voie, nous procéderons également à des examens de nos initiatives en matière d’IA, afin de tirer des leçons des pratiques exemplaires et d’intégrer ces connaissances glanées dans les futures itérations de notre stratégie évolutive.

Si l’IA offre de nombreuses capacités positives et transformatrices, elle s’accompagne de risques inhérents, tels que les préjugés, les préoccupations entourant la protection de la vie privée et les menaces pour la cybersécurité. Cette stratégie n’est pas seulement un document; il s’agit de notre engagement à mettre en œuvre les mécanismes de contrôle appropriés pour protéger le gouvernement du Canada, nos clients et les Canadiens.

Notre stratégie est une feuille de route souple. Elle évoluera en fonction des nouvelles tendances, politiques et pratiques qui façonnent le paysage de l’IA, au pays comme à l’étranger.

Alors que nous continuons de moderniser notre système d’immigration, rappelons-nous que l’innovation est à la croisée de l’ambition et de la responsabilité. Notre stratégie prépare le terrain pour un avenir où la technologie donne à nos équipes les moyens d’agir et nous aide à créer une expérience plus accueillante pour tous.

Jason Choueiri

Dirigeant principal du numérique et

Sous-ministre adjoint principal, Service client et innovation

Résumé

Immigration, Réfugiés et Citoyenneté Canada (IRCC) est à l’avant-garde de l’intégration de l’intelligence artificielle (IA) dans les opérations gouvernementales. La Stratégie d’IRCC en matière d’IA décrit comment nous utiliserons l’IA pour accroître l’efficacité, améliorer la prestation de services et renforcer l’intégrité des programmes, tout en respectant les normes éthiques les plus élevées. Elle propose également des domaines prioritaires clés pour sa mise en œuvre continue.

Le Ministère a déjà exploré le potentiel de l’IA, reconnaissant sa capacité à rationaliser les processus et à éclairer la prise de décisions. Notre succès dans l’expérimentation des premières technologies d’IA à faible risque s’est heurté à de nouvelles pressions et exigences, soulignant la nécessité d’un cadre plus délibéré pour adopter l’IA.

La Stratégie d’IRCC en matière d’IA est en harmonie avec la Stratégie en matière d’IA pour la fonction publique fédérale 2025-2027, ce qui garantit que notre utilisation de l’IA est conforme aux priorités pangouvernementales en matière d’adoption responsable, de gouvernance, de perfectionnement des talents et de transparence. En tant que chef de file dans l’expérimentation de l’IA au sein du gouvernement du Canada, IRCC continuera de fournir des commentaires et de partager les pratiques exemplaires à l’écosystème d’IA fédéral.

Notre stratégie en matière d’IA met en œuvre un cadre fondé sur les directives du gouvernement du Canada et les principes reconnus à l’échelle internationale, afin de nous assurer que nous utilisons l’IA uniquement dans l’intérêt du public, pour protéger la vie privée et l’intégrité des programmes, et pour favoriser des résultats équitables. IRCC s’engage à utiliser l’IA de façon pleinement transparente et responsable. Afin de renforcer la confidentialité et l’intégrité des programmes, nous explorerons des approches d’IA qui respectent les principes suivants : résidence des données au Canada, solutions d’IA canadiennes et innovation.

La stratégie d’IRCC en matière d’IA n’est pas seulement un plan, mais un engagement envers la mobilisation et le perfectionnement continus. À mesure que le paysage de l’IA évolue, l’approche mesurée du Ministère évoluera également, en veillant à ce qu’IRCC demeure à la fine pointe de l’innovation tout en préservant la confiance des Canadiens et de nos clients.

Cette stratégie prépare le terrain pour un avenir où l’IA sera un outil d’efficacité opérationnelle et un vecteur de changement positif, aidant ainsi le Ministère à relever les défis complexes de demain.

Vision – Où nous voulons être

IRCC met à profit le pouvoir transformateur de l’intelligence artificielle, favorisant l’innovation, la confiance et l’amélioration des résultats des programmes.

Cadre d’adoption de l’AI - Comment nous utiliserons l’IA pour atteindre nos objectifs

Mise en œuvre |

Franchir de nouvelles barrières |

||

|---|---|---|---|

Utilisation |

Tous les jours

IA pour effectuer des tâches administratives ne faisant pas partie du processus décisionnel. |

Productivité du programme

L’IA pour informer les opérations du programme. |

Expérimental uniquement

Pas d’ambition actuelle pour l’adoption en raison des risques et de la complexité. |

Tâches |

Productivité des employés Effectuer des tâches administratives tel que :

|

Productivité du programme Informer les décideurs en :

|

Mener des expériences responsables avec les technologies émergentes d’IA, par exemple utiliser l’analytique prédictive ajustable et alimentée par l’IA pour créer des modèles des flux d’immigration et prévoir les impacts sur l’économie canadienne. |

Avantages |

|

|

|

Risque |

|

|

|

Charte de l’IA

Notre approche sera la suivante :

- Contribuer au bien public,

- Accorder la priorité aux personnes,

- Respecter la vie privée,

- Promouvoir l’équité,

- Faire preuve de transparence,

- Produire des résultats fiables,

- Responsabiliser,

- Maintenir la sécurité,

- Se conformer aux pratiques exemplaires;

- Améliorer en permanence.

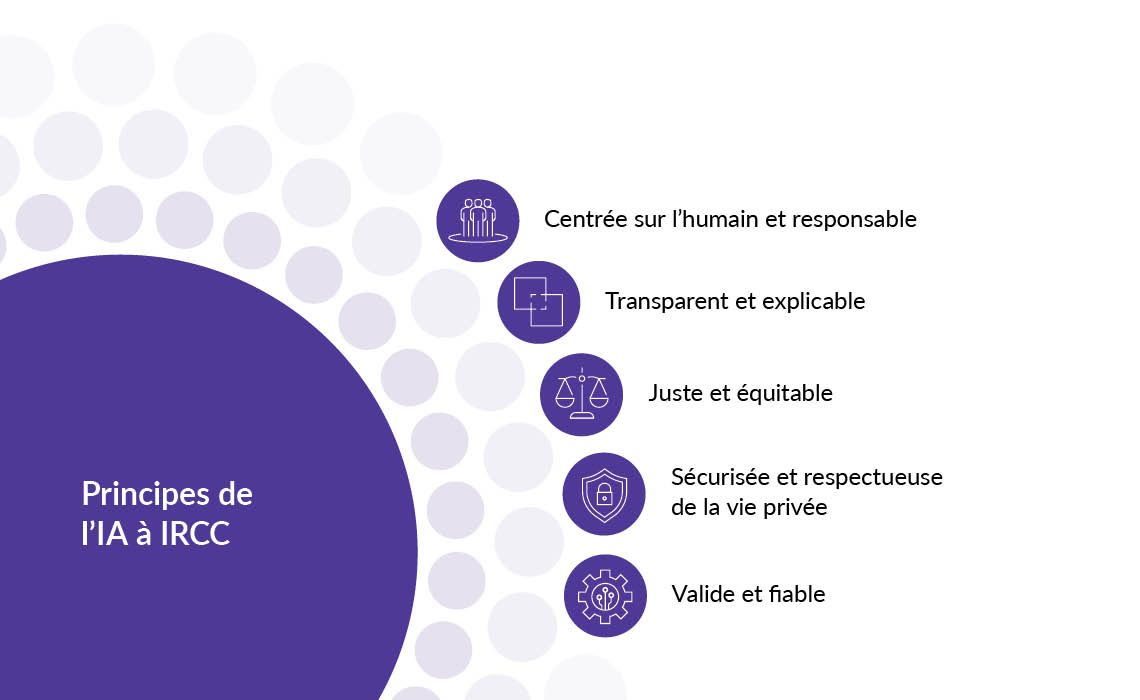

Principes d’IA

Comment nous ferons les choses correctement

Centré sur l'humain et responsable

Centré sur l'humain et responsable Transparent et explicable

Transparent et explicable Juste et équitable

Juste et équitable Sécurisé et protection des renseignements personnels

Sécurisé et protection des renseignements personnels Valide et fiable

Valide et fiable

Priorités (Activités principales)

Comment nous ferons ce qu’il faut

Établir un centre d’expertise en IA

Établir un centre d’expertise en IA Renforcer le cadre de gouvernance

Renforcer le cadre de gouvernance Bâtir un effectif prêt pour l’IA

Bâtir un effectif prêt pour l’IA Expérimenter avec l’IA

Expérimenter avec l’IA Élaborer une stratégie de mobilisation

Élaborer une stratégie de mobilisation

Contexte

IRCC a un mandat diversifié, qui cadre avec la diversité de notre pays et au rôle crucial que l’immigration continue de jouer pour le façonner. Depuis 1994, le Ministère facilite l’entrée des résidents temporaires; gère la sélection, l’établissement et l’intégration des nouveaux arrivantsNote de bas de page 1; et attribue la citoyenneté canadienne aux personnes admissibles. En 2013, nous avons pris la responsabilité supplémentaire de délivrer des passeports.

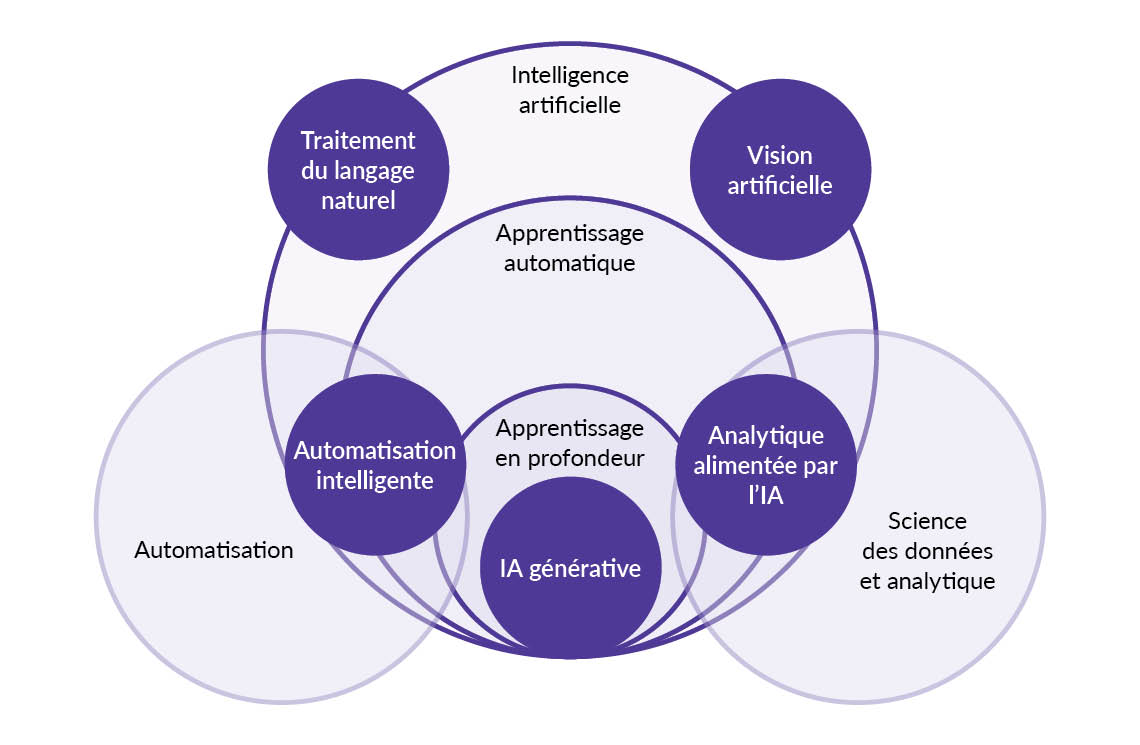

Pour remplir son mandat, IRCC tire parti des progrès technologiques afin de créer des gains d’efficience et de mieux gérer les charges de travail. Les progrès les plus rapides sont maintenant dans le domaine de l’intelligence artificielle (IA), un terme générique pour différentes technologies qui permettent aux ordinateurs et aux machines de simuler l’intelligence humaine et les capacités de résolution de problèmes (p. ex. apprendre, lire, écrire, parler, voir, analyser et faire des prédictions et des recommandations), et faire d’autres choses que les humains font.

Exploiter la puissance de l’IA

Dans le monde entier, les chercheurs, les entreprises et les gouvernements tirent parti de l’IA pour faire des pas de géant dans des domaines tels que l’automatisation de la gestion agricole (disponible en anglais seulement), la détection du cancer (disponible en anglais seulement) et la prévision des endroits où les gens vont fuir après une catastrophe (contenu disponible partiellement en français).

Notre ministère reconnaît que les gens trouvent de plus en plus utile d’utiliser des outils d’IA accessibles au public dans des contextes professionnels et personnels. Les fournisseurs de technologies ajoutent également de plus en plus d’applications alimentées par l’IA à leurs produits et services.

Grâce à l’IA, les employés peuvent exécuter des tâches administratives courantes plus rapidement, ce qui leur permet de se concentrer sur des évaluations plus complexes du risque, de la fraude, de l’admissibilité et d’autres considérations qui exigent leur jugement et leur expertise.

Bien que l’IA ait un potentiel immense, elle présente également des risques. Nous avons constaté que les systèmes d’IA peuvent perpétuer les préjugés et la discrimination, la méfiance, le manque de responsabilisation dans les décisions et les problèmes liés à la protection de la vie privée et des données. Les systèmes peuvent également être utilisés à mauvais escient par des acteurs malveillants. Lorsque ces problèmes surviennent, ils peuvent nuire aux individus et aux groupes, particulièrement aux plus vulnérables d’entre nous. Cependant, l’approche d’IRCC en matière de prise de décision automatisée est transparente et régie de manière délibérée.

Nous devons examiner attentivement les répercussions éthiques, sociales et juridiques de l’utilisation de l’IA afin d’assurer l’intégrité et l’équité de nos programmes. Il faut aussi peser ses impacts environnementaux. Et nous devons toujours protéger la sécurité, les droits, la dignité et la vie privée de nos clients et de nos employés.

Cela signifie nécessairement une approche lente et prudente pour intégrer l’IA dans nos opérations. Compte tenu des répercussions de grande portée du mandat d’IRCC et des conséquences de certaines de nos décisions qui changent le cours d’une vie, nous ne pouvons pas nous permettre d’aller de l’avant avec les nouvelles technologies et les nouveaux outils tant qu’ils n’auront pas été rigoureusement mis à l’essai et qu’ils n’auront pas été jugés fiables et sûrs.

Comment l’IA peut être utile

Alors qu’IRCC continue de traiter des volumes croissants de demandes, nous croyons que l’IA peut nous aider à relever divers défis opérationnels et administratifs et à accéder à de nouveaux débouchés, comme :

- ✓ Améliorer la prestation de services dans un contexte de préoccupations complexes en matière de sécurité et de crises humanitaires mondiales

- ✓ Surveiller les résultats des programmes au chapitre de l’intégrité et de l’équité

- ✓ Accélérer nos efforts pour réduire les arriérés et améliorer les délais de traitement

- ✓ Composer avec les contraintes croissantes en matière de ressources, les subtilités des politiques et la conformité aux lois

- ✓ Rester à l’avant-garde des menaces à l’intégrité des programmes grâce à l’IA en élaborant des mesures de lutte contre la fraude plus efficaces

Portée technologique

Forts des résultats que nous avons obtenus en tirant parti des progrès technologiques, nous explorons l’IA et les disciplines connexes afin de trouver de nouvelles occasions que nous pouvons saisir pour mieux remplir notre mandat.

Voici comment nous voyons les différents types d’IA et leurs relations entre eux, y compris en quoi ils se recoupent avec l’automatisation.

Les différents types d’IA et leurs relations

Version texte: Les différents types d’IA et leurs relations

Diagramme de Venn illustrant les technologies d'IA. Traitement du langage naturel et vision artificielle dans le cadre de l'apprentissage automatique. L'automatisation intelligente, l'analytique alimentée par l'IA et l'IA générative au carrefour, et l'automatisation et la science des données qui se chevauchent sur les bords extérieurs.

Parcours de l’IA à IRCC

IRCC est un chef de file du gouvernement fédéral dans l’intégration des progrès de l’automatisation et de l’IA depuis plus d’une décennie.

Saviez-vous qu’IRCC utilise l’IA depuis 2013 ?

Le Centre des solutions en analytique avancée au Secteur de la prestation de services d’IRCC a été créé en 2013. Le Centre a expérimenté l’IA dès le début et a mis au point des validations de principe. En 2017, la haute direction a approuvé une proposition visant à utiliser des modèles fondés sur l’IA pour produire des règles « si... alors » afin d’automatiser la gestion de la hausse des volumes de demandes de visa de résident temporaire.

Depuis, cette approche a été utilisée dans d’autres programmes de résidence temporaire et de résidence permanente pour accélérer le traitement des cas courants et renforcer l’intégrité des programmes en décelant les tendances de fraude. Selon les données internes, plus de 7 millions de demandes ont été évaluées par ce processus automatisé.

En 2020, le premier système de triage des courriels a été mis au point pour les clients qui demandaient une exemption des restrictions de voyage liées à la pandémie. Ce système infonuagique est maintenant utilisé au Centre de soutien à la clientèle d’IRCC et dans plus de 50 bureaux à l’étranger. Il fait le triage d’environ 4 millions de courriels par année, en utilisant l’IA pour cerner l’objet des demandes de renseignements des clients afin que leurs courriels puissent être traités plus efficacement.

Automatisation

IRCC utilise depuis des années une automatisation simple fondée sur des règles pour exécuter des tâches administratives et libérer les employés afin qu’ils puissent se concentrer sur des activités plus complexes. Par exemple, la technologie d’automatisation robotisée des processus peut copier des renseignements à partir d’un endroit et les coller dans un autre, ce que les employés devaient faire manuellement auparavant. Un autre exemple est le système d’autorisation de voyage électronique d’IRCC, qui est conçu à partir de règles automatisées « si… alors ». L’automatisation demeure un outil précieux pour accroître l’efficacité. Notre approche de mise en œuvre nous aide à améliorer nos processus internes et à établir des mécanismes de protection pour la gouvernance de la technologie.

Apprentissage automatique

Depuis 2018, IRCC utilise l’analytique prévisionnelle assistée par l’apprentissage automatique pour générer des renseignements à partir de décisions prises sur des demandes de clients antérieures. Ces renseignements aident à concevoir des systèmes automatisés pour trier les demandes de clients reçues en fonction de leur complexité et optimiser la répartition de la charge de travail dans notre réseau de traitement mondial. Dans certains secteurs d’activité, ces systèmes détectent les demandes simples et à faible risque, puis, à l’aide de l’automatisation des règles de gestion, valident leur recevabilité pour aider l’agent à prendre une décision définitive. Les outils d’aide à la décision fondés sur l’apprentissage automatique améliorent la productivité de notre ministère, réduisent les délais de traitement et renforcent notre capacité à détecter les risques.

À l’avenir, l’apprentissage automatique peut aider IRCC à améliorer les résultats des programmes. Par exemple, IRCC met à l’essai l’apprentissage automatique pour formuler des recommandations sur les endroits au Canada où les immigrants économiques pourraient s’établir. Ces recommandations s’appuient sur un modèle de prévision du revenu qui analyse les revenus antérieurs, une série de données statistiques axées sur les caractéristiques régionales et les préférences des clients quant à l’emplacement. Le Ministère met aussi à l’essai des outils d’apprentissage automatique qui détectent les anomalies et la manipulation possible de documents tels que les dossiers scolaires et les relevés bancaires. Ces outils peuvent nous aider à détecter la fraude en temps réel.

Automatisation intelligente

Il est important de faire la distinction entre l’automatisation courante des tâches répétitives fondée sur des règles statiques, et ce que l’on appelle l’« automatisation intelligente », qui utilise l’IA pour exécuter des tâches plus complexes et adaptables comportant l’apprentissage et la prise de décision. IRCC n’utilise pas d’agents autonomes d’IA ni de systèmes d’automatisation intelligente qui peuvent refuser des demandes de clients. Les systèmes qui apprennent et s’adaptent par eux-mêmes ne conviennent généralement pas à la prise de décisions administratives parce que leur logique peut être difficile à expliquer ou à reproduire.

Traitement du langage naturel

IRCC utilise la technologie de traitement du langage naturel pour trier les demandes des clients dans des catégories précises, ce qui permet à nos agents partout dans le monde de passer plus de temps à soutenir les clients au lieu de trier leurs questions. Le traitement du langage naturel soutient également un agent conversationnel que nous utilisons pour répondre aux demandes de renseignements généraux avec des messages préprogrammés sur les médias sociaux.

Vision artificielle

La technologie de la vision artificielle a plusieurs applications : elle peut aider à valider l’identité des personnes et à les protéger contre la fraude (p. ex. la transformation morphologique de photos); elle peut valider et recadrer automatiquement les photos de passeport conformément à nos exigences (p. ex. les normes de l’Organisation de l’aviation civile internationale [OACI]), ce qui accélère le prétraitement des demandes; et elle peut aider à protéger l’intégrité de l’examen pour la citoyenneté en ligne contre la tricherie.

IA générative

Les progrès de l’IA permettent aux systèmes de résoudre des problèmes de plus en plus complexes à une vitesse et à une échelle jamais vues auparavant. Assujettis à des lignes directrices fédérales, des employés mettent à l’essai des outils d’IA générative accessibles au public pour faciliter des tâches avancées comme le remue-méninges, la recherche et la synthèse ou l’analyse de renseignements. Nous développons également une IA générative interne qui peut, par exemple, aider nos employés internes de la bibliothèque à produire des bibliographies annotées pour les chercheurs.

Officialiser la stratégie en matière d’IA du Ministère

Nous officialisons maintenant notre stratégie en matière d’IA pour consigner et communiquer de manière transparente comment nous saisissons les possibilités que l’IA a à offrir de façon responsable. Notre stratégie en matière d’IA permet également à IRCC de réagir efficacement aux menaces à l’intégrité des programmes posées par l’IA.

Les fondements de la stratégie

IRCC est autorisé à utiliser des moyens électroniques, y compris l’intelligence artificielle, pour administrer nos programmes d’immigration, de protection des réfugiés, de citoyenneté et de passeport.

Le Ministère consacre beaucoup de temps et d’efforts à la gouvernance de l’IA, non seulement pour appuyer le travail d’IRCC, mais aussi pour faire progresser une approche pangouvernementale. Il compte des experts multidisciplinaires spécialisés dans les questions juridiques, technologiques, opérationnelles, de protection de la vie privée et de politiques qui collaborent à la gestion des enjeux liés à l’IA éthique. Il y a également un processus de surveillance et un comité de direction en place pour veiller à ce que les solutions d’IA soient élaborées et déployées de manière responsable.

IRCC a travaillé avec le Secrétariat du Conseil du Trésor du Canada à l’élaboration de la Directive sur la prise de décisions automatisée et d’outils connexes, comme l’outil d’évaluation de l’incidence algorithmique et le processus d’examen par les pairs. IRCC a publié plus d’évaluations de l’incidence algorithmique que tout autre ministère ou organisme fédéral. De plus, IRCC a créé des lignes directrices internes pour l’utilisation de l’IA générative dans le traitement des demandes.

Grâce à ces efforts, IRCC est reconnu comme un chef de file du gouvernement du Canada dans l’utilisation responsable de la technologie. Nous avons un cadre d’éthique institutionnel qui est communiqué à d’autres ministères fédéraux, aux ministères provinciaux et territoriaux ainsi qu’aux gouvernements et aux établissements universitaires du monde entier.

Harmonisation avec d’autres directives

IRCC adapte sa stratégie en matière d’IA en fonction des directives actuelles et nouvelles du gouvernement du Canada, notamment la Stratégie en matière d’IA pour la fonction publique fédérale 2025-2027, et d’autres politiques. Parmi les exemples, citons L’ambition numérique du gouvernement du Canada, qui vise à tirer parti des technologies modernes pour améliorer la prestation de services, et le Guide sur l’utilisation de l’IA générative, qui encourage une expérimentation prudente à l’échelle du gouvernement fédéral.

La Directive sur la prise de décisions automatisée demeure au cœur de notre approche. Elle exige de veiller à ce que les systèmes décisionnels automatisés soient déployés d’une manière qui permet de réduire les risques pour les clients, les institutions fédérales et la société canadienne, et qui donne lieu à une prise de décisions plus efficace, exacte et uniforme pouvant être interprétée conformément au droit canadien.

D’autres politiques et directives qui orientent notre approche relative à l’IA comprennent l’ensemble de politiques sur l’accès à l’information et la protection des renseignements personnels, la Directive sur les pratiques relatives à la protection de la vie privée, la Politique sur les services et le numérique, la Directive sur les services et le numérique, les Directives sur les normes relatives au numérique du gouvernement du Canada, la Directive sur les talents numériques, la Stratégie pour un gouvernement vert, l’analyse comparative entre les sexes plus et d’autres directives sur la sécurité, la gestion de l’identité, la lutte contre le racisme, l’équité et l’inclusion, les données désagrégées, les langues officielles, et plus encore.

IRCC collabore avec ses partenaires, dont l’Agence des services frontaliers du Canada, Statistique Canada et la Gendarmerie royale du Canada, pour uniformiser nos approches et principes en matière d’IA, ce qui nous permettra d’atteindre nos objectifs communs. Afin de renforcer la confidentialité et l’intégrité des programmes, IRCC explorera des approches d’IA qui respectent les principes suivants : résidence des données au Canada, solutions d’IA canadiennes et innovation.

D’autres travaux sont en cours pour réglementer l’IA dans les secteurs privé et public du Canada. IRCC continuera d’évaluer nos obligations juridiques concernant la façon dont nous utilisons l’IA.

Le paysage législatif et réglementaire évolue aussi rapidement que le domaine de l’IA, alors que les gouvernements du monde entier adoptent des approches différentes pour donner suite aux possibilités et aux défis que présente l’IA. IRCC continue de suivre les conversations entourant, entre autres, la Loi de 2022 sur la mise en œuvre de la Charte du numérique du Canada et la législation sur l’IA de l’Union européenne. Nous continuerons d’ajuster notre approche à l’IA en concertation avec nos partenaires fédéraux et internationaux à mesure que nous apprenons des expériences de chacun.

Nouvelles possibilités, nouveau cadre

Au lieu de s’engager prématurément à adopter une approche universelle relative à l’IA qui risque d’être désuète, la Stratégie d’IRCC en matière d’IA propose un cadre sur lequel le Ministère peut établir des fondements et des balises, élaborer et mettre à l’essai des idées et mettre en œuvre des projets à mesure que les possibilités se présentent. Les risques seront atténués, les réussites célébrées et les échecs communiqués ouvertement, ce qui contribuera à l’amélioration et à l’apprentissage continus.

La stratégie en matière d’IA est un document évolutif. Elle évoluera en fonction des nouvelles tendances, politiques et pratiques qui façonnent le paysage de l’IA, au pays comme à l’étranger.

La voie à suivre : Miser sur l’intelligence artificielle

La Stratégie d’IRCC en matière d’IA est une feuille de route destinée à servir de guide sur l’utilisation de l’IA par le Ministère pour la prestation de services, ainsi que pour d’autres fonctions externes et internes. Il s’agit également d’un engagement public. Elle définit les lignes de conduite que nous suivrons lorsque nous exploiterons tout le potentiel de l’IA pour nous adapter à l’évolution des besoins et des priorités du Ministère, ainsi que pour faire face aux menaces qui pèsent sur la cybersécurité et l’intégrité des programmes.

Énoncé de vision

« IRCC exploite le pouvoir de transformation de l’intelligence artificielle pour favoriser l’innovation, renforcer la confiance, préserver l’intégrité des programmes et en améliorer les résultats. »

Principes directeurs relatifs à l’IA

Conformément aux pratiques exemplaires largement reconnues, ainsi qu’aux valeurs et aux principes à l’égard du numérique du gouvernement du Canada, IRCC a formalisé un ensemble de principes qui serviront de cadre de haut niveau pour l’utilisation responsable de l’IA à tous les stades de son cycle de vieNote de bas de page 2. Cette approche permettra de tirer parti des avantages de l’IA, tout en atténuant les risques qui y sont associés et en protégeant les clients d’IRCC et les parties prenantes dans le processus.

IRCC utilisera l’IA de façon à ce qu’elle soit centrée sur l’humain et responsable, transparente et explicable, juste et équitable, sécurisée et respectueuse de la vie privée, et enfin valide et fiable. Ces cinq principes constituent le fondement de la Stratégie d’IRCC en matière d’IA et guideront sa mise en œuvre, y compris les politiques, processus et formations à venir en matière d’IA.

Les principles de l’IA à IRCC sont les suivants:

- centrée sur l’être humain et responsible;

- transparente et explicable;

- juste et equitable;

- sécurisée et respectueuse de la vie pirvée;

- valide et fiable.

Centrée sur l’humain et responsable

- Adopter une approche responsable en matière de gestion des systèmes d’intelligence artificielle de manière à obtenir des résultats bénéfiques pour les clients et la population canadienne. Il s’agit notamment d’utiliser l’IA pour aider les employés à répondre aux attentes en matière de service, favoriser l’inclusion des populations sous-représentées, mieux répondre aux besoins du marché du travail, améliorer le bien-être économique et social des Canadiens et garantir leur sûreté et leur sécurité.

- Utiliser l’IA dans le respect des libertés et droits fondamentaux, notamment en se conformant aux valeurs centrées sur l’humain, telles que les valeurs démocratiques, l’égalité, l’équité, la primauté du droit, la justice sociale et la protection des données et de la vie privée.

- Mettre en œuvre des mesures de protection, notamment par une supervision humaine, pour veiller à ce que les systèmes d’IA soient utilisés pour aider les personnes et à ce que les risques liés à l’absence de contexte ou à des erreurs de système soient atténués.

Transparente et explicable

- Fournir des informations utiles, adaptées au contexte et conformes aux meilleures pratiques, afin de favoriser une compréhension générale de l’utilisation de l’IA et du fonctionnement de ces systèmes. Cela peut impliquer de communiquer des détails sur les données introduites, les décisions prises par les différentes parties prenantes tout au long du cycle de vie de l’IA, et les interactions entre les humains et le système.

- Lors de la prise de décisions sur les applications, éviter les modèles d’IA de type « boîte noire » (où la logique d’un système est opaque, inconnaissable ou inexplicable). Cela irait à l’encontre du principe du droit administratif selon lequel les clients sont en droit d’obtenir une explication valable des décisions prises et de bénéficier d’une procédure d’appel

Juste et équitable

- Utiliser l’IA avec des mesures de protection explicites contre les biais lors de la conception des données et des modèles, en reconnaissant les risques accrus pour les groupes protégés ou marginalisés, et prévenir, détecter et corriger de manière proactive les résultats injustes.

- Utiliser des méthodes permettant de vérifier la présence de biais algorithmiques involontaires, de les recenser, de les comprendre, de les évaluer et de les réduire, en ayant conscience que tout système d’IA mal conçu peut nuire aux personnes, aux groupes, aux communautés, aux organisations et à la société dans son ensemble.

Sécurisée et respectueuse de la vie privée

- Garantir la sécurité des systèmes d’IA à chaque étape de leur cycle de vie, en veillant à ce qu’ils fonctionnent correctement dans des conditions normales et complexes. Il s’agit notamment de prévenir les risques, comme une perte de contrôle inopinée, une falsification des données, un piratage ou un accès non autorisé aux modèles, aux données de formation ou aux renseignements personnels.

- Veiller à ce que les renseignements protégés, classifiés, personnels ou dépersonnalisés ne soient pas saisis dans les outils d’IA accessibles au public, conformément aux directives énoncées dans le document intitulé L’IA générative dans votre travail au quotidien.

- Appliquer et faire respecter les normes et les pratiques de protection des renseignements personnels, y compris le respect de l’autonomie, de l’identité et de la dignité des personnes. Nos décisions relatives à l’acquisition, au développement et à l’utilisation de systèmes d’IA seront fondées sur des principes de protection des renseignements personnels, le principe de la protection de la vie privée dès la conception et des valeurs telles que l’anonymat, la confidentialité et le contrôle.

Valide et fiable

- N’utiliser que des systèmes d’IA dignes de confiance, cohérents et capables de produire des résultats significatifs.

- Concevoir des systèmes d’IA valides et fiables en:

- utilisant des données de formation diverses, de haute qualité et représentatives;

- contrôlant en permanence les performances et en ajustant les modèles au besoin;

- soumettant le système à divers scénarios pour en garantir la précision et la cohérence.

Protection de la vie privée

La protection de la vie privée est une priorité à IRCC. L’une des principales mesures de protection de notre stratégie en matière d’IA est le principe de la protection de la vie privée dès la conception. Nous avons mis en place des mesures de protection de la vie privée à chaque étape du processus d’acquisition, de développement, d’expérimentation et d’utilisation des systèmes d’IA dans le cadre de nos activités. Il s’agit notamment d’effectuer des évaluations obligatoires des facteurs relatifs à la vie privée, d’établir des protocoles obligatoires en matière de protection de la vie privée et de mettre en œuvre des contrôles solides pour la protection des renseignements personnels et dépersonnalisés au sein de ces systèmes.

L’étape initiale consiste à prendre des décisions sur les types de renseignements qui peuvent être introduits dans un système d’IA. Conformément au Cadre de protection de la vie privée d’IRCC, les systèmes d’IA ne doivent traiter que le minimum de renseignements personnels nécessaires à des fins précises et justifiées. Avant de déployer des systèmes ou des outils d’IA, le Ministère doit procéder à une évaluation obligatoire des besoins en matière de protection de la vie privée et mettre en œuvre les mesures d’atténuation appropriées.

À mesure que nous développerons des systèmes d’IA à des fins précises, nous intégrerons des mesures supplémentaires de protection de la vie privée, notamment en essayant d’utiliser des données synthétiques anonymisées ou générées en interne, dans la mesure du possible, afin de minimiser les risques d’atteinte à la vie privée. Lorsque cela ne sera pas possible, nous veillerons à ce que tout renseignement personnel introduit dans un système d’IA puisse être modifié et supprimé des ensembles de données et des modèles utilisés pour la formation, et à ce que les niveaux de contrôle de la confidentialité soient proportionnels à la sensibilité des renseignements personnels en question. Pour les renseignements délicats ou protégés, IRCC déploiera des capacités d’IA dans des environnements contrôlés par le gouvernement du Canada qui appliquent la résidence des données au Canada, les contrôles canadiens d’accès et la gouvernance canadienne des modèles afin de respecter la protection de la vie privée dès la conception.

Dès qu’un système d’IA utilisant des renseignements personnels sera mis en service, nous le surveillerons de près et mettrons à disposition des rapports détaillés en vue de respecter des calendriers d’examen rigoureux. Nous ferons également preuve de transparence en indiquant clairement que les résultats générés par l’IA proviennent d’un système d’IA particulier. Par souci d’exactitude, toutes les informations générées par l’IA et utilisées à l’appui de nos processus administratifs seront rigoureusement vérifiées par rapport à des sources fiables.

Enfin, nous travaillons à l’élaboration d’une approche systématique en matière de tests et d’audits réguliers adaptés à chaque type de technologie d’IA. Ainsi, nous pourrons nous assurer que nos systèmes d’IA sont conformes aux lois, politiques et normes en matière de protection de la vie privée et vérifier que tous les mécanismes de contrôle de la protection de la vie privée fonctionnent de manière efficace.

Charte sur l’IA

La Charte sur l’IA est un ensemble de règles qui décrit ce que le Ministère fera et ne fera pas en matière d’intelligence artificielle. Elle vise à guider nos équipes dans leur travail avec l’IA et à renforcer la confiance du public en fournissant un élément de référence en vertu duquel IRCC pourra être tenu responsable.

Nous n’utiliserons l’IA que de manière à :

- Contribuer au bien public : L’objectif de tout système d’IA est d’améliorer nos services dans l’intérêt de notre pays et de nos clients. C’est pour cette raison que nous sollicitons régulièrement l’avis des parties intéressées.

- Accorder la priorité aux personnes : L’IA est là pour responsabiliser les employés et améliorer leurs capacités. Une surveillance humaine doit être maintenue et les droits de la personne doivent être respectés en permanence.

- Respecter la vie privée : Si le Ministère doit utiliser des renseignements personnels dans un système d’IA, il ne les utilisera que d’une manière raisonnable et sécuritaire, et seuls les renseignements personnels nécessaires seront utilisés. Nous n’utiliserons pas les technologies de vision numérique pour établir des profils, cibler des personnes ou les suivre.

- Promouvoir l’équité : L’IA est conçue de manière à prévenir ou à atténuer les biais algorithmiques involontaires et à promouvoir des résultats équitables pour tous.

- Faire preuve de transparence : Les systèmes d’IA sont explicables, et non opaques, afin de garantir que les résultats liés à leur utilisation sont justes et que des informations et des processus clairs permettent aux individus de les contester.

- Produire des résultats fiables : Les systèmes d’IA sont régulièrement vérifiés, testés et mis à jour afin de maintenir l’exactitude, la fiabilité et l’authenticité des données produites.

- Responsabiliser : Les systèmes d’IA ne fonctionnent jamais de manière autonome. Ils sont supervisés afin d’en garantir le bon fonctionnement et le respect des cadres, des lignes directrices et des lois en vigueur. Le Ministère est responsable de tout ce que fait l’IA.

- Maintenir la sécurité : Les systèmes d’IA s’accompagnent de solides mesures de protection qui les rendent résistants aux attaques et protègent les données qu’ils contiennent contre les menaces pour la sécurité.

- Se conformer aux pratiques exemplaires : L’IA est régie par des principes et des pratiques exemplaires issus d’une surveillance permanente du paysage législatif et réglementaire mondial.

- Améliorer en permanence : Les systèmes d’IA sont peaufinés pour tenir compte des rétroactions, s’adapter aux nouveaux défis et évoluer avec les nouvelles technologies et directives, garantissant ainsi le maintien de leur efficacité et de leur fiabilité.

Cadre pour l’adoption de l’IA

Nous avons élaboré un cadre pour l’adoption d’outils d’IA. Ce cadre nous aidera à hiérarchiser les nouvelles initiatives en matière d’IA en fonction de leurs avantages et de leurs risques relatifs. Tout au long du cycle de vie d’un outil d’IA, nous veillerons au respect des politiques en matière de sécurité des TI, d’architecture, de protection des renseignements personnels, de gestion de l’information et d’autres domaines essentiels.

Une vue d'ensemble du cadre est présentée dans le résumé.

Les catégories du cadre

Le cadre comporte trois catégories distinctes.

1. Au quotidien : Utiliser l’IA pour effectuer des tâches administratives

Nous sommes prêts à accélérer l’adoption de systèmes d’IA permettant de gagner en efficacité dans les tâches routinières qui, en temps normal, nécessitent beaucoup de temps et de ressources. Ces tâches sont souvent simples, répétitives et prévisibles dans leurs données d’entrée et de sortie. L’utilisation de l’IA pour ces fonctions présente un risque minimal pour les clients. Si la prise de décisions humaine reste au cœur de la mise en œuvre des programmes, l’IA permettra alors d’améliorer bon nombre de nos processus internes. Par exemple, pour les ressources humaines, elle pourrait améliorer l’efficacité et l’exactitude des tâches administratives, ainsi que la productivité des employés. Grâce à un outil d’aide à l’analyse des demandes relatives à l’accès à l’information et protection des renseignements personnels (AIPRP), l’AI pourrait rapidement synthétiser ces demandes, notamment en indiquant où les renseignements personnels peuvent être expurgés en vertu de la Loi sur l’accès à l’information et de la Loi sur la protection des renseignements personnels.

2. Programmes : Utiliser l’IA pour éclairer les activités des programmes

Nous utiliserons les technologies de l’IA pour éclairer les décisions opérationnelles dans nos programmes, au cas par cas. Nous évaluerons soigneusement les besoins opérationnels et choisirons des solutions d’IA qui répondent à des objectifs précis plutôt que de les appliquer de manière générale. Une surveillance continue permettra de veiller à ce que ces systèmes fonctionnent de manière efficace et éthique, nous aidant ainsi à atténuer les biais ou les conséquences indésirables. En adoptant une approche judicieuse et ciblée pour l’adoption de l’IA dans des domaines de programmes donnés, nous pouvons en maximiser les avantages tout en minimisant les risques.

3. Éliminer de nouveaux obstacles : Expérimenter l’IA

IRCC ne cherche pas à adopter des systèmes d’IA entièrement autonomes. En revanche, nous continuerons à expérimenter les technologies de l’IA afin d’éclairer les futures décisions opérationnelles et stratégiques liées à l’automatisation. Une approche proactive de la compréhension et de la préparation des utilisations futures de l’IA nous permet d’être plus réactifs et résilients face à des défis inattendus, et de soutenir en fin de compte les priorités actuelles, telles qu’une meilleure gestion des crises et une prise de décisions plus efficace.

Domaines d’intérêt

L’IA peut être utilisée de façon novatrice pour aider à répondre aux besoins et aux priorités du Ministère. Plusieurs domaines d’intérêt ont été cernés au cours de consultations internes, et des cas d’utilisation réels illustrent comment son utilisation responsable et conforme aux principes et au cadre d’adoption d’IRCC peut générer de la valeur opérationnelle.

Quaid

Quaid est un agent conversationnel fondé sur des règles utilisé pour répondre aux demandes de renseignements sur le Web concernant les programmes et services d’IRCC. Il a été formé à l’aide de questions de clients réels et est continuellement mis à jour en fonction des données découlant de nouvelles questions.

Quaid peut répondre à environ 80 % des questions qu’elle reçoit avec ses réponses préprogrammées, sans aucune intervention humaine. L’outil a permis d’améliorer l’expérience client tout en réduisant la charge de travail du Centre de service à la clientèle.

Offrir des services plus personnalisés et intuitifs à la clientèle

Quaid et l’intelligence artificielle permettent d’améliorer le service à la clientèle du Ministère. En intégrant l’IA à la modernisation de la plateforme numérique d’IRCC, les portails et les plateformes peuvent modifier les interactions en fonction des besoins des clients et leur fournir des renseignements complets sur leurs demandes, tout en améliorant l’efficacité globale et la transparence du processus. Chaque interaction client vise à établir la confiance à l’égard du système d’immigration du Canada et à renforcer sa réputation de pays de destination de premier plan afin qu’il soit plus concurrentiel sur la scène mondiale.

Entrevoir de nouvelles perspectives

Harmonisée avec la Stratégie relative aux données d’IRCC et la Stratégie relative aux données de 2023‑-2026 pour la fonction publique fédérale, l’IA peut analyser des données de sources du Ministère et d’organismes partenaires afin de générer des renseignements utiles sur les nouvelles tendances et des corrélations quant au comportement des clients, d’illustrer les flux d’immigration et de modéliser les répercussions potentielles de différentes politiques. En conséquence, il est primordial que les données soient épurées et de grande qualité aux fins de formation de modèles d’IA et d’atténuation des biais, et de veiller à ce que les initiatives d’IA soient assorties d’une gouvernance robuste. Cette harmonisation améliore l’exactitude et la fiabilité des solutions génératives d’IA tout en renforçant la boucle de rétroaction qui permet au Ministère de mesurer le succès de ses efforts et d’orienter la modernisation des programmes.

Trouver le meilleur endroit où accueillir les nouveaux arrivants

En partenariat avec l’Immigration Policy Lab de l’Université Stanford, le Ministère met à l’essai un système algorithmique de recommandations d’établissement pour les nouveaux arrivants. Les algorithmes d’apprentissage machine analysent les données d’un demandeur et les comparent à des indicateurs socioéconomiques et des résultats historiques pour recommander les endroits qui lui conviendraient le mieux en fonction de ses antécédents. Les clients ne sont pas tenus de suivre les recommandations; celles-ci leur sont offertes à titre d’information à prendre en considération.

Faire preuve d’une équité rigoureuse

Par ses analyses, l’IA peut cerner les biais dans les tendances et permettre ainsi une prise de décisions éclairée, juste et équitable pour tous. De plus, l’IA peut fournir des recommandations personnalisées aux clients, s’attaquer aux inégalités et rendre les services plus accessibles aux communautés marginalisées. Ces applications de l’IA s’harmonisent avec la Stratégie de lutte contre le racisme 2.0 2021-2024 d’IRCC et d’autres initiatives du gouvernement du Canada conçues pour éliminer le racisme et la discrimination sous toutes leurs formes.

Renforcer l’intégrité des programmes

Certains acteurs externes utilisent l’IA pour créer de faux récits, fabriquer des preuves ou contourner les mesures d’intégrité des programmes d’IRCC. Heureusement, l’IA fournit également de nouveaux outils pour aider le Ministère à détecter les fausses déclarations et les fraudes, ainsi qu’à le protéger de façon plus générale contre les mauvais acteurs et les menaces de cybersécurité.

Accroître la productivité des employés

L’IA peut automatiser des tâches courantes et administratives, ce qui permet aux employés de se concentrer sur les travaux de plus grande importance, comme la prise de décisions complexes, le service à la clientèle et le perfectionnement de leurs propres connaissances et compétences. En outre, l’IA peut offrir des occasions d’apprentissage personnalisées aux fins d’amélioration continue des employés. Conformément au Plan sur l’accessibilité à IRCC, l’IA peut habiliter les personnes handicapées, notamment au moyen d’assistants virtuels qui améliorent l’accessibilité.

Services de bibliothèque

Le Ministère met à l’essai de grands modèles de langage, dont les capacités avancées de recherche, d’analyse et de synthèse améliorent ses services de bibliothèque. Si les essais sont fructueux, le personnel de la bibliothèque pourra trouver et transmettre de l’information de façon plus efficace, et améliorer ainsi la productivité des clients internes et les services qui leur sont offerts.

Soutenir les organismes partenaires

Partie importante du travail d’IRCC, le Programme d’établissement consiste à financer des organismes tiers qui fournissent des services d’établissement et de réinstallation aux nouveaux arrivants. Certains de ces organismes demandent à IRCC une orientation ou des fonds supplémentaires pour intégrer l’IA à la prestation de services. Le Ministère collaborera avec ces organismes pour comprendre comment ils utilisent ou prévoient utiliser l’IA d’une manière qui pourrait avoir une incidence sur l’expérience d’établissement d’un client. De plus, il leur fera part de pratiques exemplaires qui les aideront à mettre en œuvre des solutions d’IA conformes aux principes, aux cadres de gestion et aux lignes directrices de cette stratégie.

Rationaliser les opérations

Fort de ses progrès en matière d’automatisation et d’analytique avancée, le Ministère a recours à l’IA pour réduire les arriérés de demandes et les délais d’attente des clients, tout en améliorant l’efficacité et la cohérence de ses activités. L’IA peut aider à gérer les demandes de renseignements des clients, à vérifier l’intégralité et la validité des demandes et des documents, à évaluer l’admissibilité des clients et à acheminer les dossiers simples et à faible risque pour un examen accéléré par un agent (dossiers qui répondent à des critères définis, basés sur une liste de contrôle, et qui n’ont pas été signalés comme présentant un risque ou une complexité), comme tous les résultats sont soumis à la vérification d’un agent. Dans le contexte du Programme d’établissement, l’IA peut aider les employés à superviser les projets, à surveiller les ententes avec les fournisseurs de services d’aide à l’établissement et à analyser l’efficacité du programme. Dans ces cas comme dans bien d’autres, l’IA permet de rationaliser la prise de décisions courantes et d’éclairer la prise de décisions plus complexes.

Prioriser les initiatives d’IA

Parallèlement à son cadre d’adoption de l’IA, le Ministère met en œuvre un processus de gouvernance renforcé pour l’aider à prioriser les initiatives d’IA et veiller à ce que l’IA soit utilisée de façon transparente, équitable, proportionnelle et responsable. Ce processus évalue le niveau de risque d’une initiative et le rendement potentiel du capital investi en fonction des priorités opérationnelles et de programme d’IRCC, des ressources et du financement disponibles et de la mobilisation des intervenants, entre autres critères.

Il s’agit d’un processus itératif qui permettra d’évaluer de nouvelles initiatives d’IA et de revoir l’ordre de priorité des initiatives selon les renseignements obtenus au cours de la recherche et du développement.

Prochaine étape : mise en œuvre

La Stratégie d’IRCC en matière d’IA décrit son approche de l’utilisation de l’IA. Le Ministère travaille maintenant à la prochaine étape, qui consiste à consolider le plan de mise en œuvre de la stratégie.

Bien que l’intégration de l’IA aux activités relève de l’ensemble du Ministère, c’est le dirigeant principal du numérique qui chapeaute le plan de mise en œuvre. IRCC s’engage à rendre continuellement compte de son utilisation de l’IA, à assurer la clarté de ses objectifs auprès des intervenants, à communiquer les résultats de mise à l’essai des outils et des technologies fondés sur l’IA, à satisfaire aux exigences rigoureuses en matière de sécurité et de protection des renseignements personnels et à régir efficacement les systèmes d’IA à chaque étape de leur cycle de vie.

Le plan de mise en œuvre sera modifié au besoin pour tenir compte des travaux en cours et de l’évolution des priorités ministérielles en matière d’IA.

Des travaux sont déjà entamés dans cinq domaines de priorité en vue d’appuyer la mise en œuvre de la Stratégie d’IRCC en matière d’IA.

1. Établir un centre d’expertise en IA

Un centre d’expertise en IA est mis sur pied sous la direction du dirigeant principal du numérique. Ce centre supervisera et coordonnera les initiatives d’IA, collaborera avec les spécialistes internes et externes, effectuera des recherches sur les tendances en matière d’IA, mettra à l’essai de nouvelles technologies d’IA et favorisera l’utilisation responsable de l’IA à l’échelle du Ministère.

2. Renforcer le cadre de gouvernance

Un cadre robuste est appliqué pour régir l’utilisation responsable de l’IA et atténuer les risques décrits dans la présente stratégie.

Ce cadre définira les rôles et les responsabilités tout au long du cycle de vie de l’IA afin de faciliter l’établissement des priorités et d’éviter tout double emploi. Il intégrera également la rétroaction des intervenants, dont des experts en gestion de l’information, en technologie de l’information, en données, en gestion des risques, en protection des renseignements personnels, en services juridiques, en politiques et en communications.

3. Bâtir un effectif prêt pour l’IA

Le Ministère bâtit une main-d’œuvre prête à utiliser l’IA en donnant à ses employés les compétences et l’approche nécessaires pour s’en servir de façon responsable. À cette fin, il faut d’abord favoriser la diversité de la main-d’œuvre pour atténuer les biais et élargir les perspectives. Nous tirerons parti des programmes fédéraux de formation sur l’IA, comme ceux offerts par l’École de la fonction publique du Canada. Outre la formation de base obligatoire, la formation avancée aborde notamment les risques liés à l’IA et les répercussions juridiques. Le Ministère communiquera des pratiques exemplaires et obtiendra des certifications professionnelles pour renforcer sa capacité et son leadership en matière d’IA.

4. Expérimenter avec l’IA

Le Ministère vise à accélérer la mise à l’essai de nouvelles technologies d’IA à l’échelle de l’organisation. Son approche d’expérimentation suivra les principes d’IA énoncés dans la présente stratégie, s’harmonisera avec les méthodes de développement et de surveillance existantes et intégrera de nouvelles approches dans le cadre du cycle de vie de l’IA. Il fait part de ses mises à l’essai à d’autres ministères fédéraux pour accroître les connaissances de tous et établir des pratiques exemplaires.

Mise à l’essai d’un outil de détection de documents électroniques frauduleux

Le Ministère met à l’essai un outil de détection de faux documents alimenté par l’IA pour vérifier s’il peut l’aider à repérer les demandes frauduleuses en temps réel.

Un système de détection des anomalies alimenté par l’IA peut analyser des ensembles de données et repérer les activités potentiellement frauduleuses tout au long du processus de demande d’un client. Il peut repérer des déplacements irréguliers, des renseignements incohérents, des changements inhabituels dans les demandes ou les données biométriques, la falsification de documents, le vol d’identité ou le morphage, ou encore les dépassements de délai de validité de visa. Une fois ces anomalies signalées, les agents humains peuvent mener une enquête plus approfondie.

5. Élaborer une stratégie de mobilisation

Parallèlement à sa stratégie en matière d’IA, le Ministère élabore une stratégie de mobilisation en vue de promouvoir l’utilisation responsable de l’IA au sein de son organisation tout en renforçant sa réputation sur le plan de l’innovation et du leadership dans ce domaine. La stratégie de mobilisation renforcera ces messages de façon cohérente par le truchement des canaux appropriés. Le Ministère sollicitera également des idées pour relever ses enjeux opérationnels au moyen de l’IA, de sondages et d’initiatives, comme le Fonds d’idées des employés et les salons de l’innovation. Un élément clé de la stratégie consiste à mobiliser fréquemment les intervenants, y compris les employés, les clients et les groupes vulnérables, afin de comprendre leurs besoins et leurs préoccupations concernant l’utilisation de l’IA par l’organisation. Le Ministère collabore également avec les partenaires d’IRCC, dont les fournisseurs de services d’aide à l’établissement qui utilisent l’IA d’une manière qui a une incidence sur son organisation ou ses clients. Les commentaires que le Ministère recueille l’aident à gérer de façon proactive les relations et à éclairer son approche évolutive en matière de mobilisation, de communication et de gestion du changement.

Conclusion

La publication de la Stratégie d’IRCC en matière d’IA n’est que la première étape d’un processus itératif et interactif. Les priorités de mise en œuvre continueront d’être adaptées aux besoins opérationnels et aux directives du gouvernement du Canada.

Il est évident que l’utilisation de l’IA par le Ministère ne peut évoluer qu’à un rythme qui maintient la confiance de la population canadienne et de ses clients. Le Ministère s’engage à sensibiliser les intervenants, les partenaires et le public à sa stratégie en matière d’IA et à tenir compte de leurs commentaires au fur et à mesure de sa progression.

L’avenir de l’IA est à la fois illimité et prometteur. Le Ministère et tous les intervenants sont prêts à l’explorer, ensemble.

Glossaire

| Terme | Définition |

|---|---|

| Analytique avancée | Utilisation de techniques complexes pour analyser des données, extraire des renseignements et découvrir des modèles ou des tendances en vue d’éclairer la prise de décisions. |

| Évaluation de l’incidence algorithmique (EIA) | Outil utilisé pour évaluer les effets potentiels d’un système d’IA, particulièrement sur le plan de l’équité, de la responsabilisation et de la transparence. |

| Intelligence artificielle | Technologie capable d’exécuter des tâches qui nécessitent habituellement une intelligence humaine, comme comprendre le langage parlé, apprendre des comportements ou résoudre des problèmes. |

| Agent conversationnel | Application logicielle alimentée par l’IA, conçue pour simuler la conversation humaine et couramment utilisée dans les services à la clientèle. |

| Vision par ordinateur | Technologie d’IA qui saisit et interprète l’information visuelle à partir d’images ou de vidéos numériques, et qui permet aux systèmes d’analyser et de comprendre le monde visuel. |

| Intelligence artificielle générative | Technologie d’IA qui crée du contenu, comme du texte, de l’audio, du code, des vidéos et des images, à partir d’invites simples. Les utilisateurs ont surtout recours aux grands modèles de langage (p. ex. ChatGPT) pour effectuer certaines tâches, comme la rédaction, le résumé et la traduction de texte. |

| Automatisation intelligente | Combinaison de technologies d’IA et d’automatisation utilisées pour optimiser des tâches et des processus. Celles-ci imitent souvent une prise de décisions humaines plus exacte et plus rapide. |

| Grand modèle de langage | Système d’IA avancé capable de comprendre et de générer du texte de type humain en analysant de grandes quantités de données écrites. Il permet d’effectuer certaines tâches, dont la conversation, la traduction et la création de contenu. |

| Apprentissage automatique | Vaste sous-ensemble de l’IA qui permet aux algorithmes d’apprendre à partir de données et de faire des prédictions ou prendre des décisions sans être explicitement programmés pour le faire. |

| Modèles | Représentations mathématiques qui apprennent à partir de données pour faire des prédictions ou prendre des décisions. Ces modèles aident le système à comprendre les tendances et à effectuer certaines tâches, comme la reconnaissance d’images ou la génération de texte. |

| Morphage | Transformation graduelle d’une image, d’une forme ou d’une donnée en une autre, souvent utilisée dans le montage ou l’animation d’images pour créer des transitions et des variations harmonieuses. |

| Traitement du langage naturel | Technique qui permet aux systèmes d’IA de comprendre, d’interpréter et de générer le langage humain d’une manière pertinente sur le plan contextuel. |

| Automatisation fondée sur des règles | Automatisation de tâches répétitives en fonction de règles et d’instructions prédéfinies « si-alors » pour assurer l’uniformité et l’exactitude. |

| Données synthétiques | Données créées artificiellement qui imitent les données réelles, mais excluent les renseignements personnels ou sensibles qu’elles peuvent contenir. Utilisées pour les modèles de formation, la mise à l’essai d’algorithmes et la protection de la vie privée. |